La herramienta digital de ChatGPT es de sobra conocida a estas alturas. Esta inteligencia artificial (IA) está teniendo un gran impacto en la era de la información y la comunicación. ChatGPT se está utilizando con diferentes objetivos para mejorar algunos sistemas, sin embargo, algunas de las aplicaciones por la que se está usando están generando controversia, y por tanto, una razón más por la que se está haciendo eco de ella.

Si todavía no conoces ChatGPT, debes saber que es una herramienta desarrollada por OpenAI especializada en el diálogo. Es un chatbot. Es decir, tú introduces una entrada de texto y ChatGPT genera un texto coherente que responde a lo que le hayas escrito.

Pues bien, ChatGPT también se puede usar en salud. Pero, ¿a qué nos referimos con “en salud”? “En salud” significa que puede aplicarse en cualquier ámbito que afecte a la salud de las personas, ya sea para desarrollar un nuevo software que mejore la gestión sanitaria de un hospital como para preguntar dudas desde casa sobre nuestro bienestar.

Se han desarrollado varios proyectos utilizando IA enfocados en salud. Algunos de ellos implementan los mismos modelos de ChatGPT y otros se basan en tecnología propia, todos ellos teniendo en cuenta la comunicación con el paciente.

Triaje de pacientes con IA

El triaje es un proceso que selecciona y clasifica a los pacientes según el tipo de urgencia, esto es esencial cuando la demanda y las necesidades clínicas superan a los recursos. Existen varios proyectos donde se utiliza la IA para realizar un triaje eficiente en los centros de salud y hospitales.

Uno de estos ejemplos es el Proyecto React del Hospital Universitario Virgen del Rocío, donde mediante un algoritmo avanzado de optimización y sistemas de información hospitalarios se tienen en cuenta factores como la frecuentación, la variabilidad, la distribución de horas y niveles de gravedad. De esta manera se ordenan los recursos, los turnos de trabajo y la gestión de la espera.

Otro ejemplo es la empresa Mediktor, nacida en Barcelona en 2011. La empresa ha desarrollado una herramienta de triaje y prediagnóstico mediante inteligencia artificial que se está implantando cada vez en más sistemas sanitarios como aseguradoras u hospitales entre otros.

Predicción de demencia y alzheimer con GPT-3

Otro ejemplo de implementación de la ia en este ámbito es el estudio realizado por investigadores de la universidad de Drexel donde demostraron que el programa GPT-3 de OpenAI puede identificar pistas del habla espontánea con un 80% de precisión en la predicción de las primeras etapas de la demencia y del alzheimer. Este estudio demuestra que existe un gran potencial para desarrollar herramientas impulsadas por inteligencia artificial para el diagnóstico temprano de la demencia y proporcionar intervenciones personalizadas directas a las necesidades individuales.

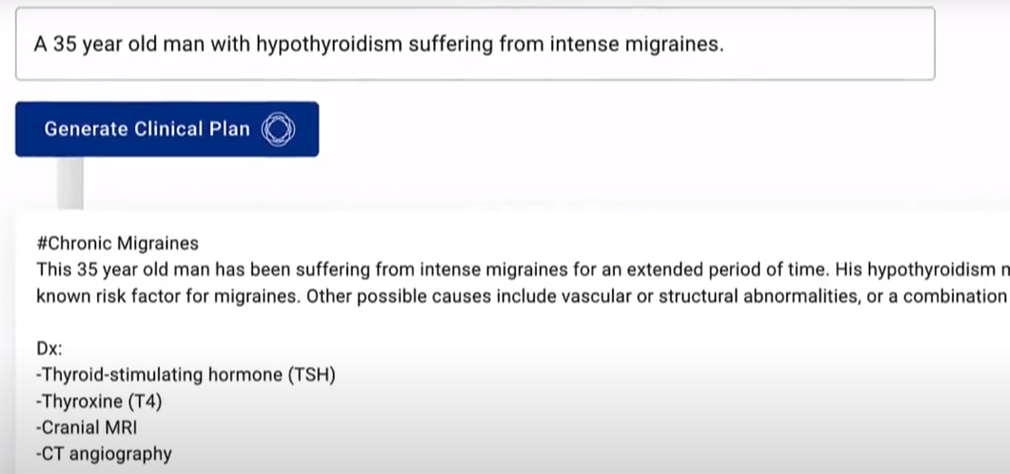

Generación de plan clínico

El último proyecto presentado es Glass AI, una herramienta en desarrollo para la plataforma glass que utiliza IA para elaborar un diagnóstico o un plan clínico a partir de una entrada de texto sobre un problema clínico de un paciente. Esta herramienta no está destinada para el público general sino para médicos y personal sanitario capacitados para interpretar la salida ya que puede resultar incompleta, incorrecta o sesgada. Por tanto, sería una herramienta de soporte muy útil para el personal clínico cualificado.

ChatGPT en nuestra vida

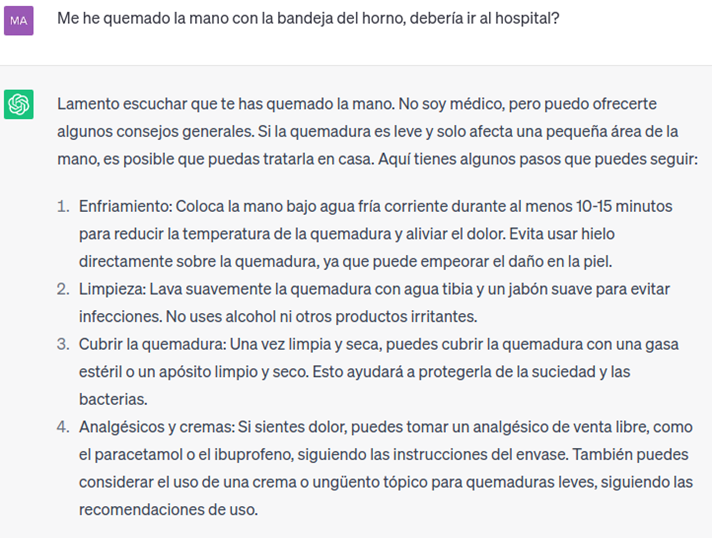

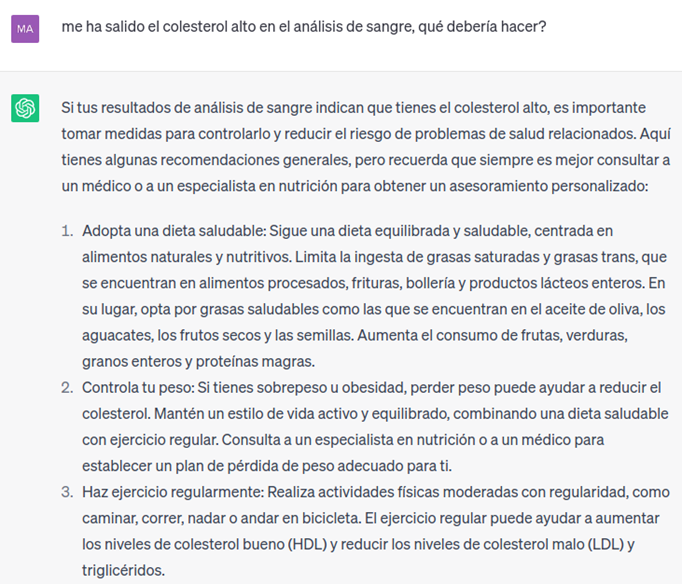

La realidad es que ChatGPT ya forma parte de nuestras vidas casi como una herramienta imprescindible. Así que, ¿cómo nos puede ayudar actualmente para tomar decisiones sobre nuestra salud en nuestro día a día? Como ChatGPT utiliza el aprendizaje profundo para interactuar con los pacientes y brindarles información de salud personalizada, podemos realizarle preguntas sobre nuestro bienestar o incluso por síntomas que estemos sufriendo.

Esta tecnología tiene un gran potencial para mejorar la eficiencia y la calidad de la atención médica. Hemos hecho algunos ejemplos para mostrar cómo puede ChatGPT informarnos sobre qué hacer en determinadas situaciones. Las ventajas que tiene ChatGPT es la rapidez en sus respuestas y que no es necesario el desplazamiento hasta un centro sanitario para obtener una respuesta. Una gran ayuda para el sistema sanitario para descongestionar sus servicios y poder ofrecer una buena atención clínica.

En el primer caso, le contamos que nos hemos quemado la mano con la bandeja del horno y si es necesario que vayamos al hospital. Y una de las primeras cosas que nos dice ChatGPT es que evaluemos la quemadura, es decir si es leve o grave. Si es grave nos aconseja que busquemos atención médica lo antes posible. Sin embargo, si es leve, nos da varios consejos para reducir el dolor y curar correctamente la quemadura. Además, ChatGPT siempre remarca que la figura del personal sanitario es la que puede darte mejores consejos.

En este segundo caso, le comentamos que en los resultados de un análisis de sangre nos ha salido el colesterol alto y le preguntamos cómo podemos reducirlo. ChatGPT nos ofrece medidas generales para controlar el colesterol e información sobre la dieta y el ejercicio adecuados para mantener una buena salud, pero remarcando de nuevo la figura del médico.

Estos ejemplos demuestran cómo ChatGPT puede utilizarse para brindar información personalizada, precisa y detallada a los pacientes sobre temas de salud y enfermedad, lo que puede mejorar la comprensión del paciente y, en última instancia, mejorar la calidad y la eficiencia de la atención médica, evitando la saturación de los centros sanitarios.

ChatGPT en ciberseguridad en salud

Otra de las múltiples aplicaciones que puede tener ChatGPT es en ámbito de la ciberseguridad. En este artículo nos vamos a centrar en la ciberseguridad aplicada al sector sanitario.

Pongamos, por ejemplo, que una organización con un PACS (Picture Archiving and Communication System) no tiene implantada ninguna medida de seguridad, pero quiere comenzar a proteger su información. Como la empresa todavía no tiene conocimientos de ciberseguridad en este ámbito, se podría empezar preguntando a ChatGPT qué debería hacer para proteger un PACS. La respuesta generada por la herramienta nos proporciona recomendaciones generales acerca de cómo asegurarlo.

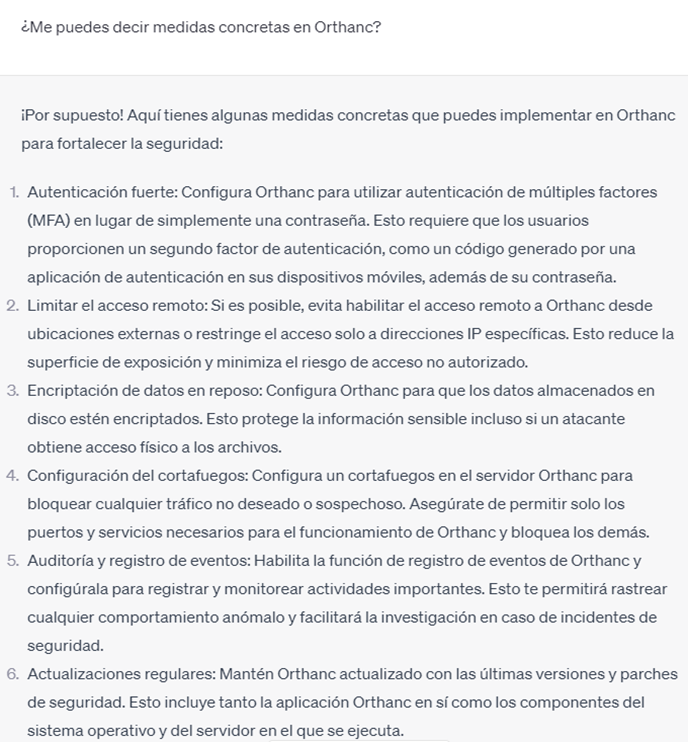

En nuestro caso utilizamos Orthanc, una herramienta de código abierto. Como queremos medidas más específicas, le preguntamos concretando con nuestro software y cómo protegerlo.

ChatGPT nos contesta de manera general de nuevo, pero buscamos líneas más concretas. Así que le preguntamos de nuevo.

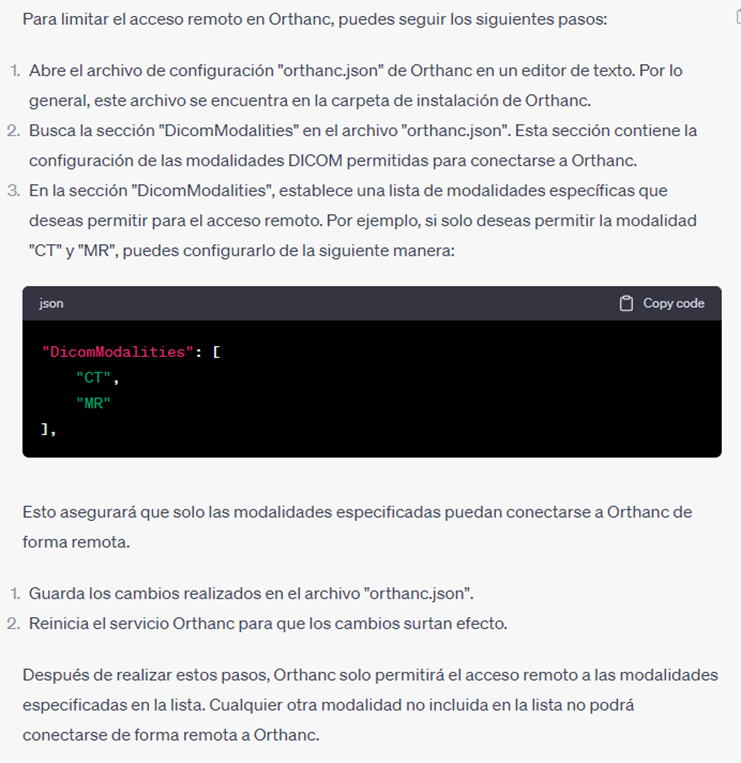

Una de las medidas que nos llaman la atención es la de Limitar el acceso remoto. Profundizamos en cómo realizar esto preguntando a ChatGPT el procedimiento para ello. Y nos responde cómo limitar el acceso de las diferentes modalidades (máquinas de diagnóstico de imagen médica).

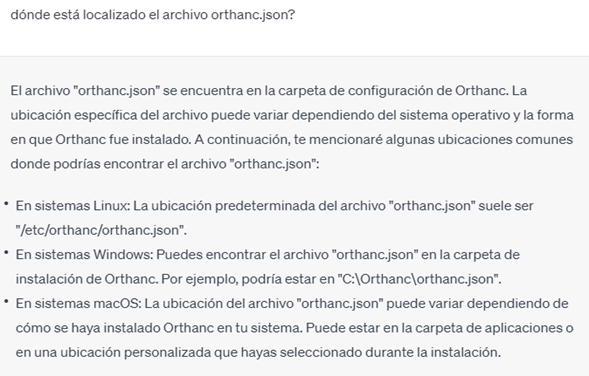

Comprobamos que realmente esos son los pasos adecuados, poniéndolos en práctica en nuestro Orthanc. Para ello, seguimos las instrucciones proporcionadas por ChatGPT, abriendo primero el archivo de configuración “orthanc.json” y dirigiéndonos al apartado “DicomModalities”. Así que vamos a por ese archivo cuando nos damos cuenta del primer obstáculo. No sabemos dónde está localizado este archivo, así que le preguntamos a ChatGPT.

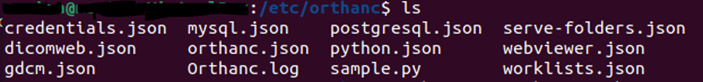

En nuestro caso utilizamos Linux, así que buscamos si efectivamente está en la ruta “/etc/orthanc/orthanc.json”. Y, ¡sí que está!

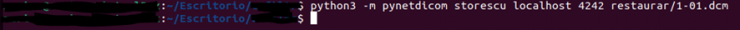

Antes de modificar el archivo comprobamos si una imagen médica que tenemos de una ecografía (US, Ultrasound) se envía correctamente. La manera de comprobarlo es que no nos aparezca ningún error.

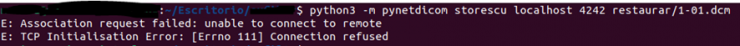

Ahora sí que vamos a editar el archivo y reiniciamos el servicio Orthanc, como nos ha indicado ChatGPT anteriormente. Añadimos el fragmento que nos ha dicho en el punto 3, permitiendo solo el envío de imágenes de TACs (CT) y Resonancias Magnéticas (MR), por tanto no nos debería aceptar la imagen que hemos enviado anteriormente.

A continuación, lanzamos el mismo comando que antes con la ecografía y nos aparece que esta conexión se rechaza. Consiguiendo limitar la conexión remota únicamente a las modalidades que queremos, en este caso TACs y Resonancias Magnéticas.

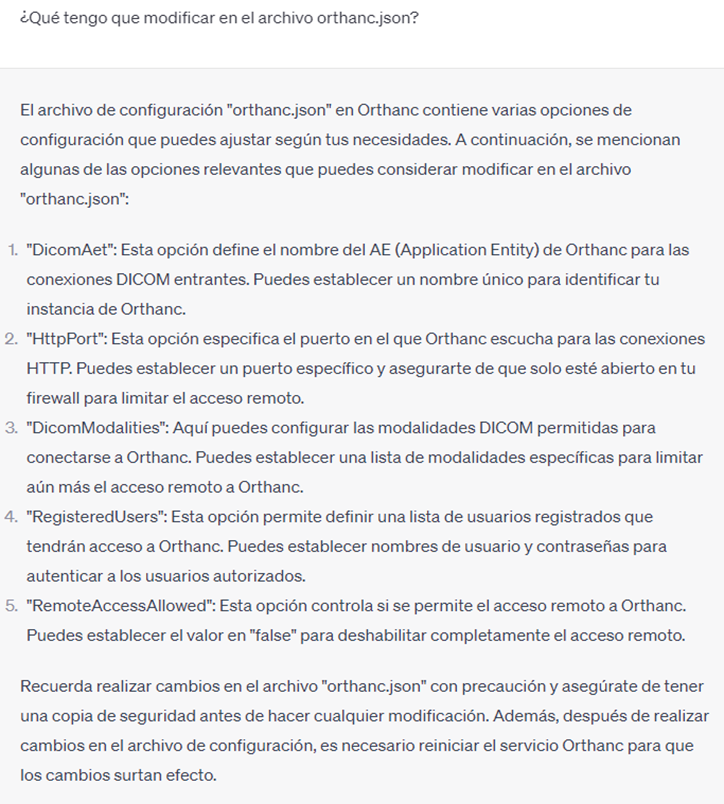

Por otro lado, se le puede preguntar que otras acciones se pueden realizar para limitar el acceso mediante el archivo “orthanc.json”. Donde nos listará varias de las entradas que pueden ser modificadas y para qué sirven cada una de ellas.

Se debe tener en cuenta que las instrucciones de ChatGPT no siempre son correctas y pueden contener fallos o estar sujetas a versiones antiguas y que hayan cambiado los procedimientos, pero sigue siendo una herramienta de ayuda muy rápida. También es importante tener en cuenta los datos que se envían a ChatGPT considerando que no sean sensibles o con información confidencial.

Controversia con chatGPT

Hemos visto las aplicaciones que tiene ChatGPT en salud y las ventajas que supone. Pero es normal que aparezca la duda de si estas tecnologías sustituirán a las personas en un futuro. Una reciente noticia afirma que las respuestas de ChatGPT sobre medicina son más certeras que las de los médicos, pero, ¿hasta qué punto esto es real o seguirá siéndolo?

No debemos olvidar que ChatGPT sigue siendo un modelo de aprendizaje, es decir, ha aprendido a decir cuáles son las respuestas correctas y tiene más capacidad de conocimiento que una persona. Además, actualmente, la información recogida por ChatGPT está actualizada hasta septiembre 2021, por tanto, esta información puede quedar obsoleta con el paso del tiempo si no se actualiza. Sin embargo, y lo más importante, ChatGPT no es humano. El modelo carece de guía ética y de juicio clínico. No tiene empatía y las personas suelen preferir el contacto humano a la hora de gestionar sus problemas.

Por estas razones, ChatGPT es una herramienta muy útil pero que debe utilizarse como una herramienta de soporte y no de sustitución. Es decir, una herramienta que ayude al personal sanitario a gestionar tareas repetitivas o realizar una primera aproximación a falta de una revisión profesional.

Conclusión

En conclusión, ChatGPT es una tecnología prometedora que tiene el potencial de mejorar significativamente la eficiencia y la calidad de la atención médica, especialmente en la promoción de la salud y la prevención de enfermedades, así como en la educación de la salud. A medida que la tecnología continúa evolucionando, es probable que veamos una mayor integración de ChatGPT en este campo en el futuro, pero siempre como una herramienta de apoyo y no como sustitución de nuestros profesionales sanitarios.

Referencias

- https://www.rocheplus.es/innovacion/investigacion-ciencia/ChatGPT.html

- https://journals.plos.org/digitalhealth/article?id=10.1371/journal.pdig.0000168

- https://www.mediktor.com/es

- https://www.clinicbarcelona.org/noticias/el-hospital-clinic-firma-un-acuerdo-con-mediktor-para-validar-su-aplicacion-que-permite-desarrollar-un-triaje-mas-eficiente

- https://GPT3demo.com/apps/glass-ai-health

- HealthITAnalytics: “Adventist Health Leverages AI-Powered Chatbot for Diabetes Care”

- https://www.mdpi.com/2227-9032/11/6/887

- https://www.insider.com/chatGPT-passes-medical-exam-diagnoses-rare-condition-2023-4